La llegada inminente de iOS 17 ya nos ha permitido conocer las primeras novedades oficiales por parte de Apple. Estas se centran en la accesibilidad, y van a mejorar muchas de las que ya tenemos actualmente. Pero también, vamos a ver nuevas funciones que van a cambiar la manera con la cual interactuamos con el iPhone. Así que si quieres conocer de qué se tratan, en este post te las damos a conocer.

Lo que se ve, tan importante como lo que se oye

Una de las mejores funciones de accesibilidad del iPhone es Lupa. Esta aplicación integrada nos permite usar la cámara para hacer zoom a objetos y textos que, por problemas de visión, podríamos no alcanzar a ver a simple vista. No obstante, esta va a expandir sus funcionalidades gracias a Point and Speak, una nueva opción que se incorporará con iOS 17.

Cuando abramos la app de Lupa y enfoquemos algo con la cámara, si ese objeto tiene texto, podremos hacer que el iPhone diga qué es eso que estamos enfocando, para leer esas letras de texto en voz alta. Esto es posible gracias a la combinación de los siguientes elementos:

- La propia cámara del iPhone

- El sensor LiDAR que incorporan algunos modelos

- La funcionalidad de VoiceOver

- La inteligencia artificial del iPhone, que hace que el dispositivo vaya aprendiendo a medida que lo vayamos usando

Así pues, no se trata de una función que, una vez que llegue, «se quede ahí». Sino que, a medida que la vayamos utilizando, esta vaya conociendo nuestros hábitos de uso y pueda reconocer objetos de una manera más acertada y, por tanto, distinguir los textos con más precisión. Tal y cómo explica la propia compañía, esta nueva herramienta está pensada para personas con ceguera o con problemas de visión severos.

La nueva accesibilidad del iPhone abarca mucho

Uno de las mayores fortalezas del ecosistema Apple es la integración con los otros dispositivos. Aquí el Mac entra en juego, ya que va a ser compatible con un nuevo accesorio que ya estaba disponible en los teléfonos. Estamos hablando de los audífonos, y si ya teníamos dispositivos que fueran compatibles con el estándar Made for iPhone, ahora los podremos sincronizar con el ordenador.

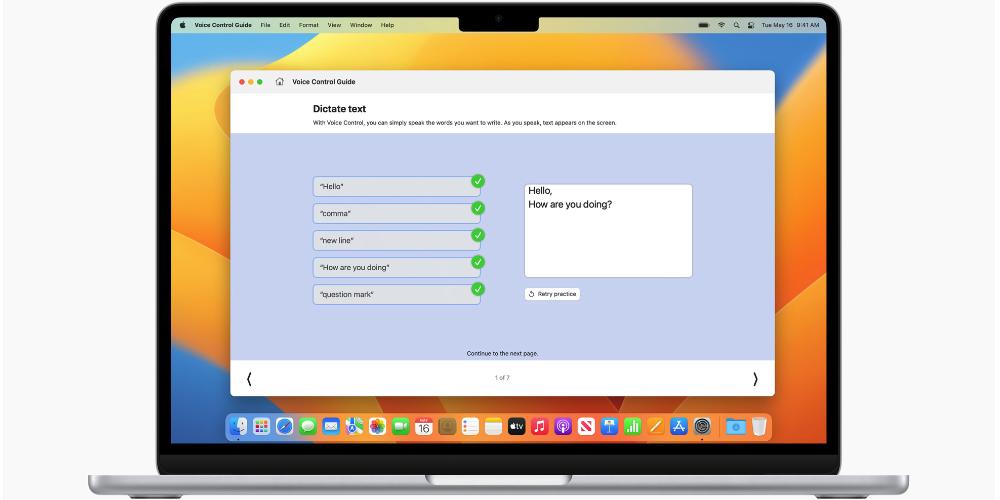

Pero el iPhone no sólo hace que escuchemos mejor, sino que también habla por nosotros, y es capaz de leer lo que le pidamos. Gracias a las funciones de Control por Voz y Voice Over, esto es posible. Ahora bien, con iOS 17, estas se han visto potenciadas, aumentando las posibilidades de uso. Y es que ahora podremos pedirle al iPhone, iPad o Mac, mediante nuestra voz, las diferentes acciones que queremos que lleve a cabo, gracias a la nueva guía de Control por Voz.

Siguiendo en el terreno de la accesibilidad auditiva, han mejorado la funcionalidad de Voice Over. En este caso la mejora pasa por la naturalidad en la que la voz de Siri se expresa cuando variamos la velocidad. Cuando disminuimos o aumentamos la rapidez con la que queremos que el iPhone nos lea algo, ahora podremos entenderlo mucho mejor, gracias a la mejora en la dicción y pronunciación.